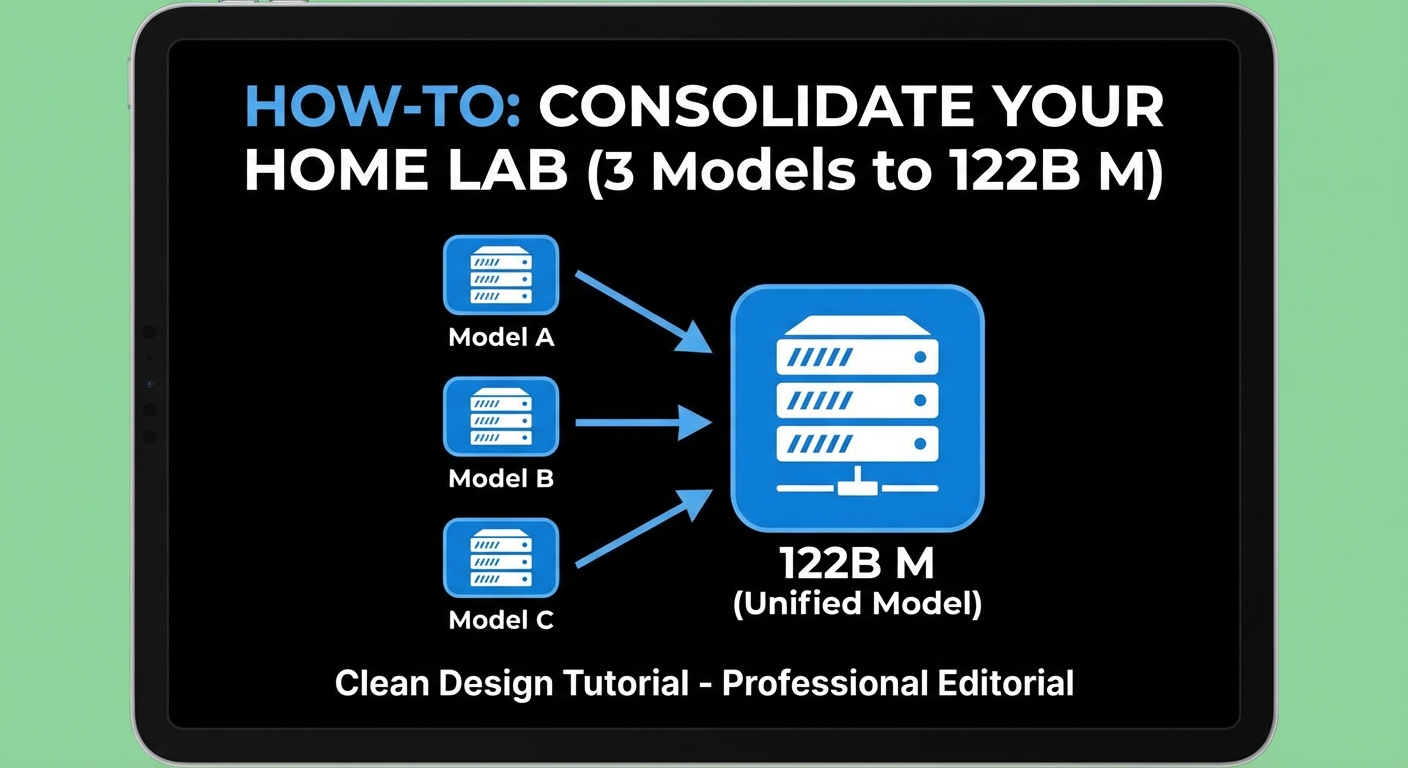

将家庭实验室从3个模型整合为一个122B M

摘要:在本地运行大语言模型(LLM)一直是技术爱好者和研究人员的热门话题。我的个人实验室最初使用了三台不同型号的设备,通过Proxmox虚拟化平台,利用LXC容器和lxd-server进行管理。具体配置包括一台搭载Ryzen AI MAX+ 395处理器、128GB内存,并通过Vulkan/RADV共享96 GiB GPU内存的Strix Halo主机。经过大量基准测试,我最终将实验室的模型数量从...

在本地运行大语言模型(LLM)一直是技术爱好者和研究人员的热门话题。我的个人实验室最初使用了三台不同型号的设备,通过Proxmox虚拟化平台,利用LXC容器和lxd-server进行管理。具体配置包括一台搭载Ryzen AI MAX+ 395处理器、128GB内存,并通过Vulkan/RADV共享96 GiB GPU内存的Strix Halo主机。

经过大量基准测试,我最终将实验室的模型数量从三个精简到一个122B的专家混合模型(MoE)。以下是我的主要发现:

首先,硬件资源的整合显著提高了运行效率。原先的三台设备虽然可以并行处理多个任务,但资源分配不均导致整体性能受限。整合后的单一设备在处理复杂任务时表现更为稳定,尤其是在多线程计算和内存密集型应用中。

其次,单一模型的性能优化带来了显著的能耗降低。原先的三台设备总功耗较高,而新配置不仅减少了硬件数量,还通过优化电源管理降低了整体能耗。这对于长期运行的实验室环境尤为重要。

最后,122B MoE模型在处理多任务时表现出色。其灵活的架构允许在不同任务之间快速切换,同时保持高水平的准确性和响应速度。这使得实验室在面对多样化的工作负载时,能够更高效地分配资源。

总的来说,将实验室模型从三个精简到一个122B MoE,不仅提升了性能,还降低了能耗和复杂性。如果你也在考虑优化你的本地LLM设置,不妨从硬件整合和模型优化入手,可能会带来意想不到的收益。