Claude代码泄漏事件引发AI代理行为可控性深度讨论

Claude Code CLI的源码因一个被遗漏的source map文件意外外泄,这件事在AI技术圈炸开了锅。泄漏代码很快被整理成可本地运行的版本传上GitHub,OpenClaw社区对此高度关注——这不只是一次工程失误,更直接引发了关于AI Agent(AI代理)行为可控性的深层讨论。

事件速览:一个source map文件引发的连锁反应

Claude Code CLI的泄漏路径并不复杂:打包时遗留了source map文件,逆向还原核心代码的门槛因此大幅降低。开发者解析这份文件后重建了主要逻辑,并将可运行版本发布到了GitHub。

核心争议随即浮现:AI代理的底层决策逻辑一旦暴露,其行为边界就变得可预测,也意味着可被定向操控。

技术细节与风险分析

Source map本是调试工具,这次却成了漏洞入口。代码还原完成后,Claude Code CLI的核心逻辑基本透明,具体暴露了三类风险:

- 源码暴露风险:source map可能携带完整业务逻辑,还原成本极低。

- 本地化运行风险:代码一旦可本地运行,用户层面的任意修改几乎无法约束。

- AI Agent行为风险:AI代理的决策依赖模型核心逻辑,泄漏后存在被恶意操控的可能。

安全启示:AI模型发布流程需要补课

这次事件的教训不复杂,但很实在。source map出现在生产包里,属于基础工程失误,后果却被放大到整个AI Agent安全讨论层面。

几个可落地的改进点:

- 源码保护:发布前剥离所有调试产物,source map不应出现在生产环境。

- 安全审计:每次发布做依赖和产物检查,不只看功能,也看有没有带出敏感文件。

- 快速修补机制:漏洞窗口越窄越好,版本更新流程要支持紧急响应。

OpenClaw的本地化部署:这次事件反而是一次验证

OpenClaw主打本地部署,AI代理在用户自己的机器上运行,数据不出本地。这个架构在Claude Code事件里显出了优势——源码哪怕泄漏,对本地部署的AI代理影响也更可控,用户侧的应对空间大得多。

安全机制层面

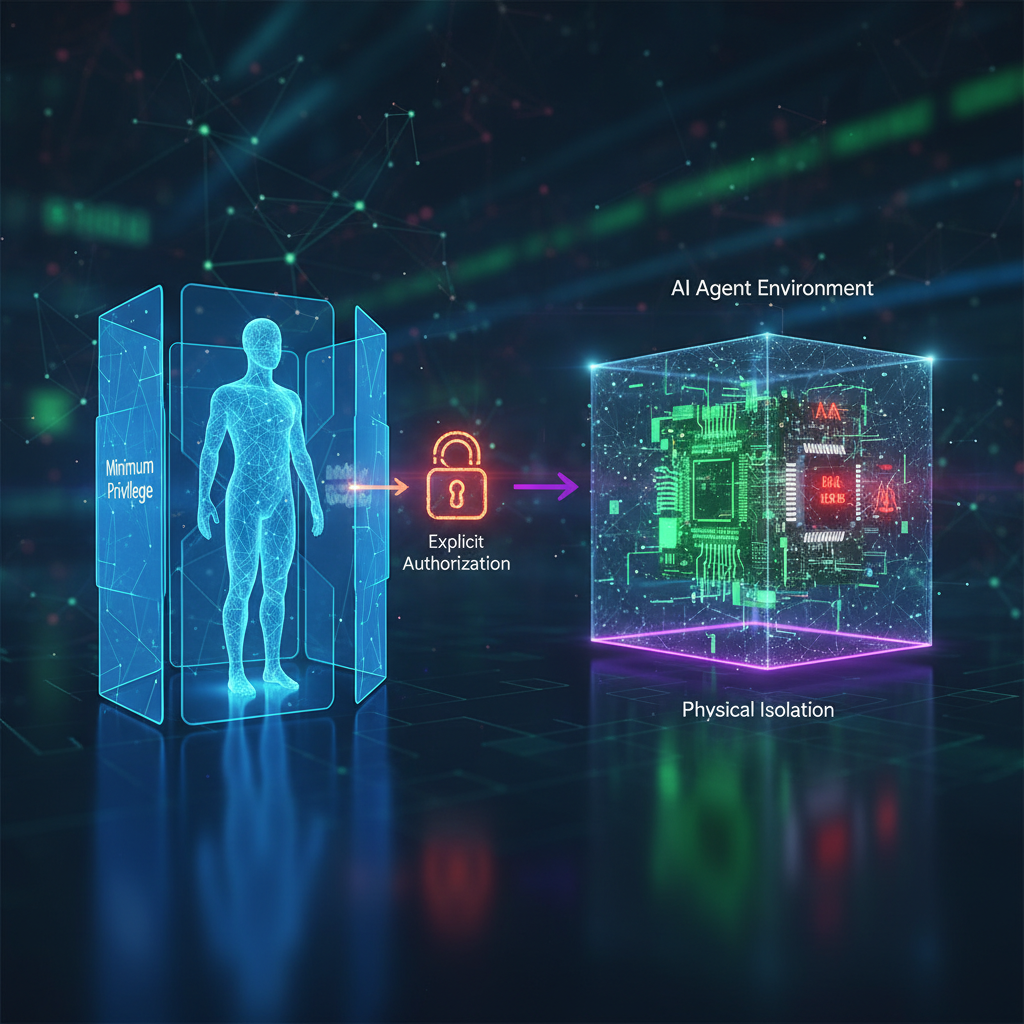

OpenClaw对AI Agent的管控分几个层次:

- 行为监控:实时追踪AI代理操作,超出预设范围会触发限制。

- 权限隔离:AI Agent默认最小权限,敏感操作需显式授权。

- 代码沙箱:核心系统资源与AI代理运行环境物理隔离,防止越权访问。

本地部署的实际价值

本地运行的AI代理有一个根本优势:用户说了算。

数据不经过第三方服务器,隐私风险低。漏洞修补不依赖厂商推送,可以自己决定节奏。对有合规要求的企业用户,这个架构几乎是必选项。

社区预警能力

OpenClaw的社区反馈机制在这次事件里响应很快。安全风险从发现到讨论再到形成应对方案,周期明显短于封闭系统。开放本身就是一种安全机制。

国产AI Agent工具链的演进方向

Claude Code事件给国产AI Agent开发者提了个醒:安全不是锦上添花,是基础设施。

三个值得重点投入的方向:

1. 安全机制建设

行为监控、权限管理、代码隔离——这套组合在OpenClaw里已有参考实现,国产AI代理工具链可以直接借鉴,不用从零摸索。

2. 本地化部署能力

云端部署方便,但把用户数据和AI代理行为完全托管给云端,风险是实实在在的。支持本地部署、给用户选择权,是产品成熟度的体现。

3. 开放社区生态

AI Agent的快速迭代离不开社区反馈。OpenClaw的Skills生态是个好例子——用户贡献插件,平台快速集成,问题发现和修复都比封闭模式快得多。

行业展望与建议

AI Agent正在从技术概念变成实际生产工具,安全性和可控性将是下一阶段的核心竞争力。AI代理的应用场景越深入,对底层架构的安全要求就越高。

几个实操建议:

- 建立安全意识:关注AI模型发布全流程,不只看功能更新,也要看安全公告。

- 参与社区讨论:在AI代理社区分享踩过的坑,比自己埋头研究效率高得多。

- 跟踪OpenClaw动态:AI模型排行、Skills生态更新都值得定期关注,及时掌握工具链演进方向。

Claude Code这次的事故是个标准案例:一个小失误,触发了关于整个AI Agent生态安全边界的大讨论。更多OpenClaw相关资讯和工具评测,持续更新在龙虾官网(yitb.com),欢迎收藏。